我一直以来都有收集VPS信息的需求,所以很多时候我都在一边手动录入一边看看有没有什么好方法可以获取VPS信息。看到哪个商家有新套餐,我就需要自己开官网然后获取相关的价格、CPU、内存、硬盘等硬件。

但是更多的时候,就是商家更新了套餐的价格或者套餐,我又得去花时间获取最新的内容,因为很多人都是通过我来获取最新的VPS讯息,如果我自己没办法第一时间整理正确的信息和归纳,那大家对我的信任感肯定会降低。

在我后续的整理当中,我看到XCrawl好像可以满足我的需求。我就去官网查看相关的说明,发现还真的没问题,只需要结合 Claude Code + MCP + XCrawl 就可以变成一个真的能干活的 AI 工作流。

最主要的还是注册就送1000积分,我们可以先体验在看看是不是满足自己的需求,如果满足在付费也不迟。

这套组合怎么分工

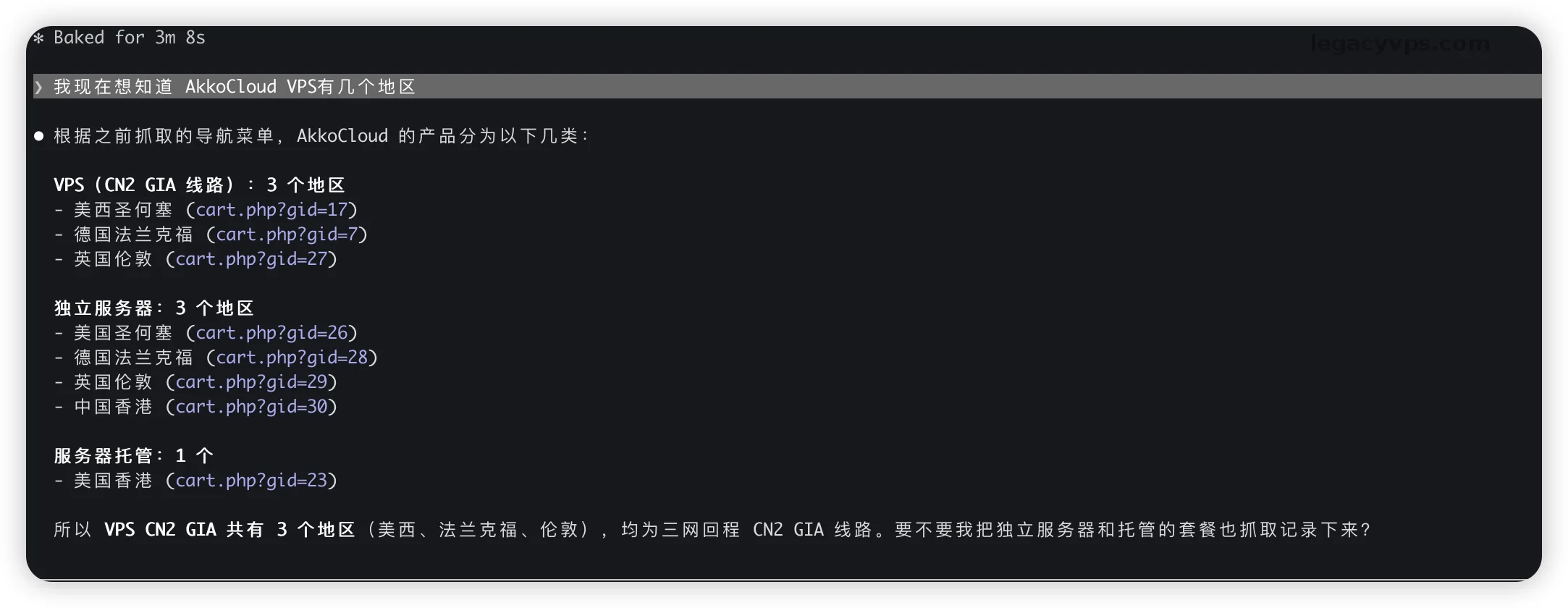

根据官方的说明,我没有把 XCrawl 当成一个单独的抓取工具看,而是结合Claude code和他自己的Skills,整理成一个AI工作流里。不再是独立的一部分,而是可以接入自己的数据信息系统,我自己就是把它放在了VPS数据收集当中。

Claude Code负责理解任务、拆采集步骤、决定下一步MCP负责把外部能力接进来XCrawl负责真正去搜索、抓取公开网页,再把结果返回成 LLM 友好的内容

如果Claude code还没有安装,参考:Claude Code 安装教程:Mac、Windows、Linux 从 0 到跑通

你只要把三层一接起来,最后的感觉是不一样的。以前我是自己先想“先搜什么、再抓什么、最后怎么整理”;现在是我把目标交代清楚,让 Claude Code 带着 XCrawl 去跑。它不是替我做最终判断,但它能先把前面那堆脏活做掉。我再也不需要不关心数据怎么来的,只需要数据有了我就可以干活了。

注意:这套东西更适合公开网页的前期收集,不适合拿来替代真实上机测试。套餐能不能买,最后还是要回到测试 IP、线路、磁盘和你自己的实际用途。

先把 XCrawl 跑通

我这里先按最小可跑通的路径写。先把 CLI 装上,账号登录好,确认它能正常返回结果,再接进你自己的 Claude Code 工作流。我现在就是这么干的,先安装好XCrawl在配置API Key,最后下载对应的Skill接入Claude code。

# Node.js 需要 >= 18

npx -y @xcrawl/cli --help

# 或者全局安装

npm install -g @xcrawl/cli

xcrawl --help

认证我更建议直接走浏览器登录,省事一点:

xcrawl login --browser

xcrawl status

如果你本来就习惯手动配 key,也可以直接这样:

xcrawl login --api-key <YOUR_API_KEY>

xcrawl status

按照上面的步骤,基本上就没有什么问题可以直接使用xcrawl去测试一下能不能获取到网页的内容,如果能返回所需的内容就没问题。

获取相关的Skill:官方skill地址

简单演示

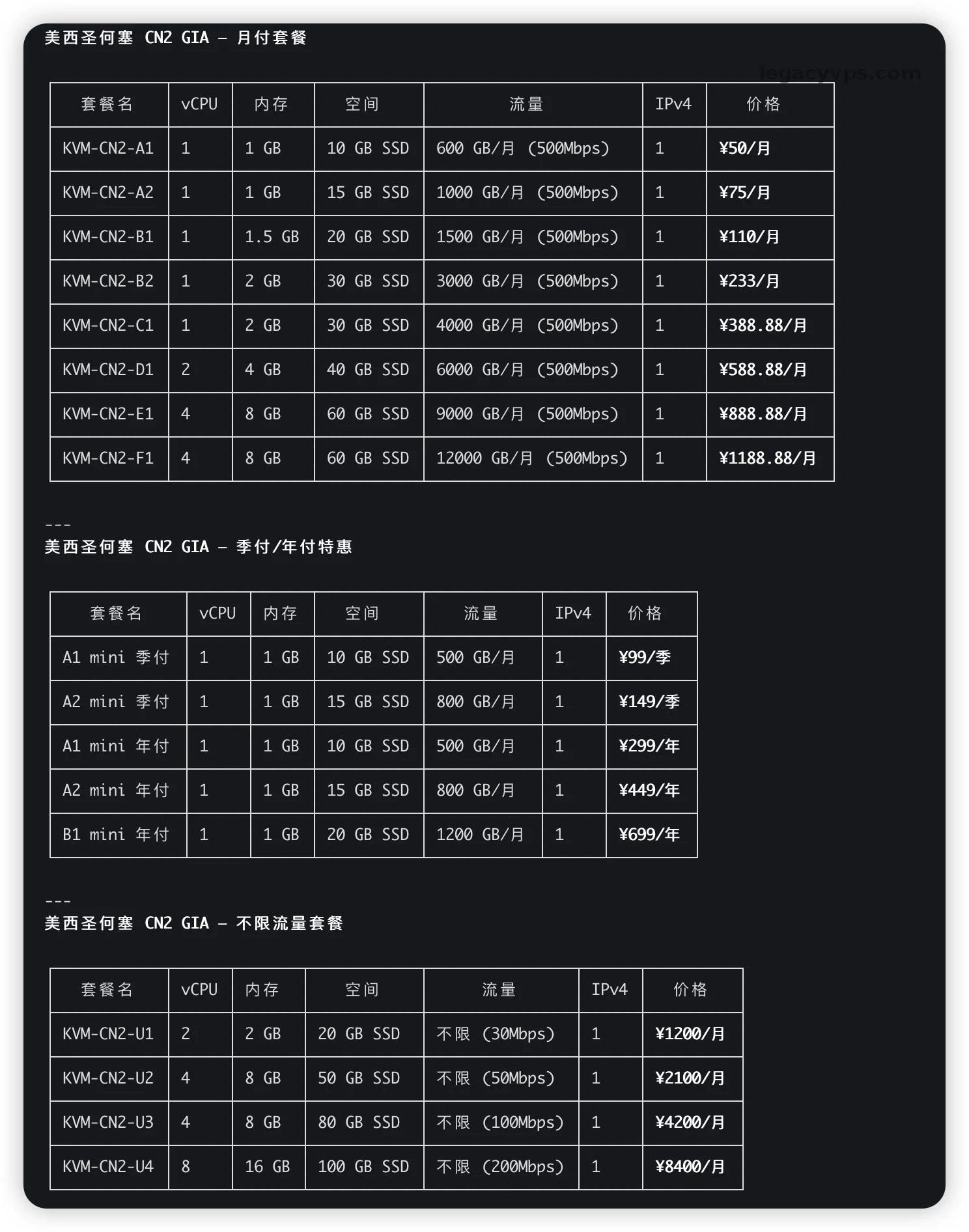

最简单的使用,就是你需要通过XCrawl获取什么数据,我这里演示了一下获取一家IDC的网站,里面美国VPS的所有信息:

使用 xcrawl访问:https://www.akkocloud.com/cart.php 获取套餐信息并整理

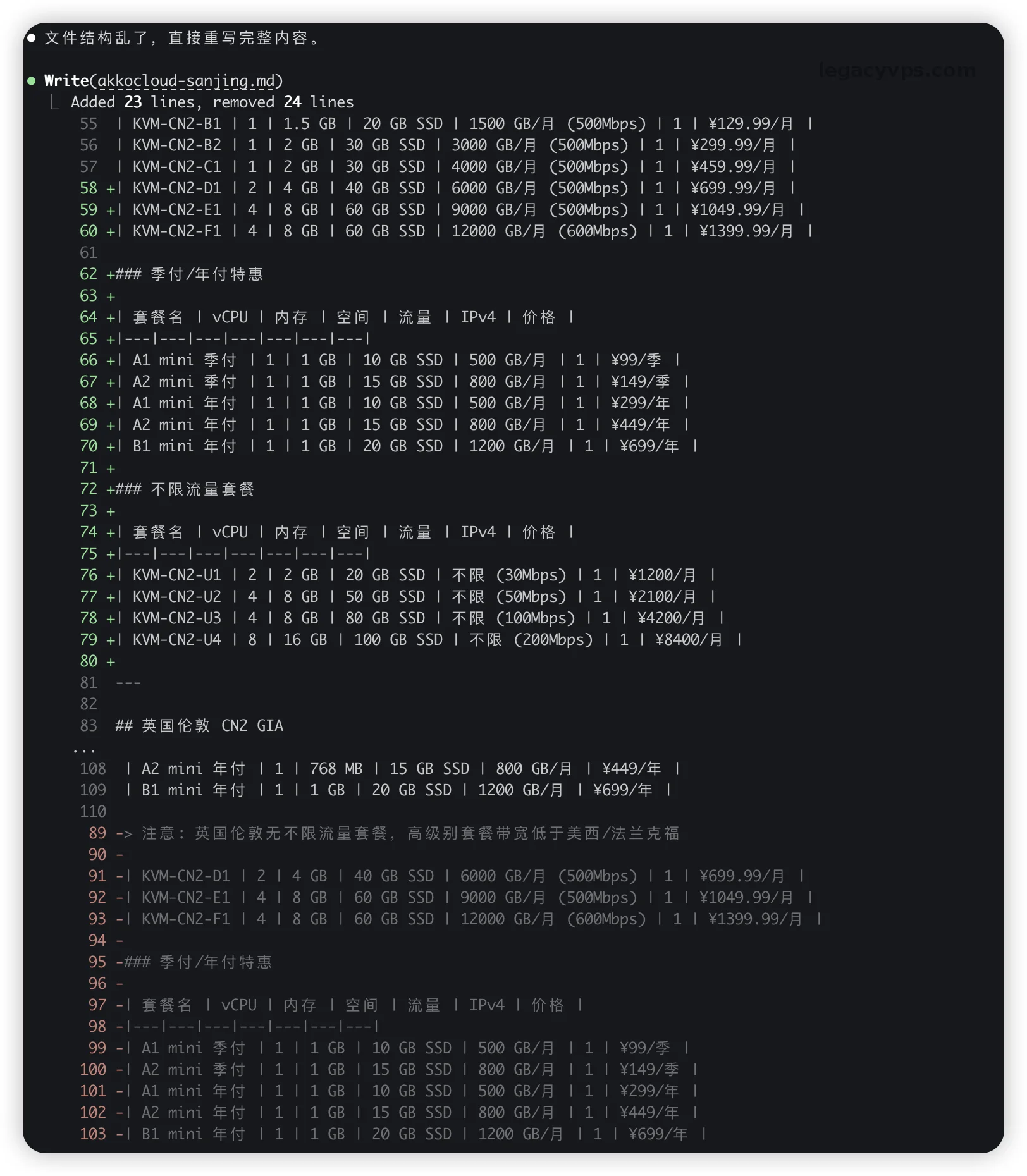

可以看到很快就把相关的美国VPS给我归纳整理好了,后续我只需要写入文档当中,等待后续的使用就可以了。

跑一遍实操

我先的阶段是,整理我自己的VPS知识库,找到我自己最喜欢的几家IDC商家,然后获取地区、价格、套餐、配置。

根据这些内容搭建一套知识库,等我后续需要使用的使用,就可以直接拿出来使用了。

流程:

获取套餐 -> 整理数据 -> 数据入库 -> 数据展示筛选 -> 面向客户

筛选测试:

测试下来很完美,数据都持久化入库了。而且IDC那么多套餐的数据,我只用了几分钟,我现在有了这些数据。比如最便宜的套餐是哪些,这个IDC商家有哪些地区的VPS,我都只需链接本地的数据,就可以完成了。

我为什么选择XCrawl

我测试一天,最后留下这套组合,不是因为它多厉害,而是它刚好补上了 Claude Code 最缺的一块:把公开网页数据先收回来。其实写代码也可以实现,但是真正的业务的时候,我们不一定有那么多时间去处理。最主要的是XCrawl给我带来的方便快捷,还能主动接入Claude code当中实现AI的提效。

总结下来:

CLI 先跑通很快,适合先验证再接工作流

搜索、抓取、整理这条链路能顺着接起来

返回格式对 LLM 友好,不用我自己再做一轮重清洗

如果你现在也有数据采集的需求,我也建议可以体验一下XCrawl现在注册就送1000积分。然后没事装好 XCrawl,让 Claude Code 带它跑通一次“搜索 -> 抓取 -> 整理”,你很快就能感觉到,这条路至少比手动获取数据方便的多。

如果你想试试,现在马上就来吧:xcrawl地址